#capas versus AI

Text

Capistas versus Inteligência Artificial

Hoje vamos falar de um tópico que aparentou estalar alguma polémica nos últimos tempos no Spirit Fanfics, que diz respeito à utilização de artes criadas por inteligência artificial.

Como tem sido um tema recorrente, e infelizmente, a IA tem vindo para ficar em muitos campos das nossas vidas, desde a informática, a elaboração de trabalhos escolares, entre muitas outras facilidades que a Inteligência Artificial nos oferece. Apesar de a ferramenta ter a sua utilidade em alguns casos, também pode, se usada incorretamente, causar danos a longo prazo.

Vamos aos fatos.

O que é a Inteligência Artificial, afinal?

A inteligência artificial (IA) é a capacidade que uma máquina tem para reproduzir competências semelhantes às humanas como é o caso do raciocínio, a aprendizagem, o planeamento e a criatividade.

A IA permite que os sistemas técnicos percebam o ambiente que os rodeia, lidem com o que percebem e resolvam problemas, agindo no sentido de alcançar um objetivo específico. O computador recebe dados (já preparados ou recolhidos através dos seus próprios sensores, por exemplo, com o uso de uma câmara), processa-os e responde.

Os sistemas de IA são capazes de adaptar o seu comportamento, até certo ponto, através de uma análise dos efeitos das ações anteriores e de um trabalho autônomo.

Fonte: Site do Parlamento Europeu

Em suma, a IA permite, através de uma completa análise do ambiente digital, bem como do ambiente "humano", criar soluções e mesmo alternativas para diversas problemáticas do dia a dia.

61% dos europeus têm uma opinião positiva sobre a inteligência artificial, mas 88% consideram estas tecnologias exigem uma gestão com cautela. (Eurobarómetro 2017, UE28)

Fonte: link (eng)

2. O que influencia a Inteligência artificial no nosso dia-a-dia?

É verdade que enquanto pessoas do dia-a-dia comum, lidamos com a inteligência artificial em vários campos. Quer seja nos nossos smartphones, quer seja nos variados websites que visitamos, a IA veio para ficar e tentar introduzir novas formas de se ambientar às nossas necessidades. No entanto, existem grandes problemáticas ainda associadas ao uso de IA, que não estão devidamente regulamentadas. Apesar de a IA não ser algo do "agora", visto que existe há mais de 50 anos, a verdade é que com o enorme crescimento tecnológico que vamos enfrentando de dia para dia, as regulamentações sobre o uso desta tecnologia, principalmente no que concerne a direitos de autor e copyright está um pouco em falta.

No meio disto tudo, onde a IA entra na edição de capas?

Cada vez mais tem sido crescente o volume de edições com a indicação nos créditos de artes geradas por IA.

Em muitas situações, principalmente capistas que prestam serviços para projetos e/ou mesmo a título próprio, têm dificuldades em encontrar fanartistas que - produzindo artes que encaixam perfeitamente naquela descrição que o escritor nos entrega - autorizem o uso das suas artes, e em tantos outros momentos, encontrar artes oficiais que realmente combinem com a vibe da nossa capa é extremamente exaustivo e mesmo chega a dar vontade de desistir daquele projeto, ou tentar arranjar uma alternativa viável como a fotomanipulação.

Certo?

Errado!

Em muitos casos alguns capistas tem escolhido pedir a bots de AI como este ou este, e até as próprias plataformas como o Canva permitem aos seus utilizadores fazerem uso da IA para criarem seus desenhos e/ou projetos de IA, sem terem todo o trabalho e/ou aprendizado por detrás de algumas das coisas (desde design, a desenho, vocês nomeiam).

(arte gerada por IA com os prompt Naruto, Angst).

Como é possível ver, o do Canva não traz opções muito abonatórias ao personagem que escolhemos, mostrando até mesmo um design muito diferenciado daquele que é o tão conhecido por nós.

Muitas das artes geradas por IA tem por base um banco de dados de milhões de imagens espalhadas pela internet, retiradas de sites, motores de busca e mais recentemente até do próprio Tumblr, que fornece diretamente material de texto e imagens a alguns websites considerados 3rd parties que podem fazer uso das artes, textos e outros elementos de forma abusiva, muitas vezes sem o consentimento dos seus utilizadores, podendo até violar em alguns casos, leis de copyright e Creative Commons.

Em partes, o uso de IA pode, na sua parte, ser comparável ao uso de artes sem autorização do fanartista, já que estamos a editar conteúdo que o mesmo não permite para tal, e fazendo uso de propriedade intelectual que não é nossa - até porque as imagens geradas por IA nada mais, nada menos são que um conglomerado de traçados de outras pessoas da internet.

Para quem usa o argumento de que as pessoas que condenam o uso das IA para estas questões, e que não deveriam, então, consumir conteúdo feito de fãs para fãs, desde que autorizado pelos autores das obras, ficção de fãs (fanfiction) e artes de fãs (fanarts) são permitidas e estão protegidas, da mesma forma, por direitos de autor e copyright - e sim, postarem as vossas fics criadas pelo Chatgpt é igualmente ilegal porque os materiais base são gerados, adivinhe, de outras fanfics de coleguinhas seus, então vamos ser sensatos!

Cada um, claro, é livre de expor a sua opinião, e apontar defeitos aqui e acoli, no entanto, é importante perceber que a IA, apesar de em tese ser algo que é bom - porque é uma ferramenta que pode, efetivamente, trazer muita ajuda para situações futuras - também é uma ferramenta que, a longo prazo, caso não seja regulamentada da forma correta, poderá prejudicar diversos criadores de conteúdos de várias formas e até mesmo designers, criadores de websites, entre outros, porque, parando para pensar, se a IA pode criar algo parecido com o trabalho humano, por que contratar alguém para esse lugar?

E a verdade é que muitas empresas hoje em dia já pensam dessa forma.

Outro argumento que vi ser usado a favor do IA foi comparar o "negar o uso da IA nas capas" com pirataria de conteúdos de subscrição (filmes, séries, anime, manga, ect.).

Gente!!!!!! A pirataria deste tipo de conteúdos, sempre foi, apesar de moral e eticamente errada, uma forma de protesto contra o capitalismo. De forma alguma deve ser equiparada à utilização de IA, contra a qual diversos artistas, tanto digitais como tradicionais já se mostraram contra, até mesmo dubladores de seriado e anime, artistas musicais, entre outros.

Em suma, cada um é livre de fazer o que pretender, mas tenham consciência que sim, o uso de IA em capas é errado.

"Ah mas Diih, aposto que você não credita todos os recursos que usa numa capa"

Certo. Muitas vezes, por termos material solto, e acredito que muitos capistas se identificam com isso, nem sempre conseguimos fazer rastro de quem realmente criou aquele recurso. No entanto, capistas devem sempre se assegurar que estão a usar recursos gratuitos e que são permitidos para uso, e acima de tudo, se os obtiveram de criadores que não autorizam uso comercial, não tentar vender os designs com esses recursos - isso é senso comum básico!

Acho que já tagarelei o bastante neste post, então vou deixar-vos com esta leitura reflexiva.

Disclaimer: com este post não viso atacar ninguém, mas como estou fora do Spirit, ainda assim gostava de dar a minha opinião sobre o tema, com argumentos que eu próprio vi ou que amigos meus me encaminharam, e como capista há mais de 5 anos na plataforma, vim dar meus 2 cêntimos de opinião.

Bebam água e se cuidem, beijos do tio Diih!

Este texto pode ou não ter seguido o acordo ortográfico, eu sou idoso e isso não foi betado, vocês que lutem ❤️

#capas para fanfic#capas para spirit#capas versus AI#spirit fanfics#fofoca do dia#arte visual#edições#inteligência artificial

12 notes

·

View notes

Text

The Puzzle Of Whether AI Should Have Rights, Including The Case Of Autonomous Cars

If we assign human rights to AI, using the Universal Declaration of Human Rights as a guide, the AI can make some independent judgements. (WIKIPEDIA COMMONS)

By Lance Eliot, the AI Trends Insider

Sometimes a question seems so ridiculous that you feel compelled to reject its premise out-of-hand.

Let’s give this a whirl.

Should AI have human rights?

Most people would likely react that there is no bona fide basis to admit AI into the same rarified air as human beings and be considered endowed with human rights.

Others though counterargue that they see crucial reasons to do so and adamantly are seeking to have AI be assigned human rights in the same manner that the rest of us have human rights.

Of course, you might shrug your shoulders and say that it is of little importance either way and wonder why anyone should be so bothered and ruffled-up about the matter.

It is indeed a seemingly simple question, though the answer has tremendous consequences as will be discussed herein.

One catch is that there is a bit of a trick involved because the thing or entity or “being” that we are trying to assign human rights to is currently ambiguous and currently not even yet in existence.

In other words, what does it mean when we refer to “AI” and how will we know it when we discover or invent it?

At this time, there isn’t any AI system of any kind that could be considered sentient, and indeed by all accounts, we aren’t anywhere close to achieving the so-called singularity (that’s the point at which AI flips over into becoming sentient and we look in awe at a presumably human-equivalent intelligence embodied in a machine).

I’m not saying that we won’t ever reach that vaunted point, yet some fervently argue we won’t.

I suppose it’s a tossup as to whether getting to the singularity is something to be sought or to be feared.

For those that look at the world in a smiley face way, perhaps AI that is our equivalent in intelligence will aid us in solving up-until-now unsolvable problems, such as aiding in finding a cure for cancer or being able to figure out how to overcome world hunger.

In essence, our newfound buddy will boost our aggregate capacity of intelligence and be an instrumental contributor towards the betterment of humanity.

I’d like to think that’s what will happen.

On the other hand, for those of you that are more doom-and-gloom oriented (perhaps rightfully so), you are gravely worried that this AI might decide it would rather be the master versus the slave and could opt on a massive scale to take over humans.

Plus, especially worrisome, the AI might ascertain that humans aren’t worthwhile anyway, and off with the heads of humanity.

As a human, I am not particularly keen on that outcome.

All in all, the question about AI and human rights is right now a rather theoretical exercise since there isn’t this topnotch type of AI yet crafted (of course, it’s always best to be ready for a potentially rocky future, thus, discussing the topic beforehand does have merit).

For my explanation about the singularity, see the link here: https://aitrends.com/ai-insider/singularity-and-ai-self-driving-cars/

For the presumed dangers of a superintelligence, see my coverage at this link here: https://aitrends.com/ai-insider/super-intelligent-ai-paperclip-maximizer-conundrum-and-ai-self-driving-cars/

For my framework explaining the nature of AI autonomous cars, see the link here: https://aitrends.com/ai-insider/framework-ai-self-driving-driverless-cars-big-picture/

For my indication about how achieving self-driving cars is akin to a moonshot, see this link: https://aitrends.com/ai-insider/self-driving-car-mother-ai-projects-moonshot/

A grand convergence of technologies is enabling the possibility of true self-driving cars, see my explanation: https://aitrends.com/ai-insider/grand-convergence-explains-rise-self-driving-cars/

Less Than Complete AI

One supposes that we could consider the question of human rights as it might apply to AI that’s a lesser level of capability than the (maybe) insurmountable threshold of sentience.

Keep in mind that doing this, lowering the bar, could open a potential Pandora’s box of where the bar should be set at.

Here’s how.

Imagine that you are trying to do pull-ups and the rule is that you need to get your chin up above the bar.

It becomes rather straightforward to ascertain whether or not you’ve done an actual pull-up.

If your chin doesn’t get over that bar, it’s not considered a true pull-up. Furthermore, it doesn’t matter whether your chin ended-up a quarter inch below the bar, nor whether it was three inches below the bar. Essentially, you either make it clearly over the bar, or you don’t.

In the case of AI, if the “bar” is the achievement of sentience, and if we are willing to allow that some alternative place below the bar will count for having achieved AI, where might we draw that line?

You might argue that if the AI can write poetry, voila, it is considered true AI.

In existing parlance, some refer to this as a form of narrow AI, meaning AI that can do well in a narrow domain, but this does not ergo mean that the AI can do particularly well in any other domains (likely not).

Someone else might say that writing poetry is not sufficient and that instead if AI can figure out how the universe began, the AI would be good enough, and though it isn’t presumably fully sentient, it nonetheless is deserving of human rights.

Or, at least deserving of the consideration of being granted human rights (which, maybe humanity won’t decide upon until the day after the grand threshold is reached, whatever the threshold is that might be decided upon since we do often like to wait until the last moment to make thorny decisions).

The point being that we might indubitably argue endlessly about how far below the bar that we would collectively agree is the point at which AI has gotten good enough for which it then falls into the realm of possibly being assigned human rights.

For those of you that say that this matter isn’t so complicated and you’ll certainly know it (i.e., AI), when you see it, there’s a famous approach called the Turing Test that seeks to clarify how to figure out whether AI has reached human-like intelligence. But there are lots of twists and turns that make this surprisingly for some a lot more unsure than you might assume.

In short, once we agree that going below the sentience bar is allowed, the whole topic gets really murky and possibly undecidable due to trying to reach consensus on whether a quarter inch below, or three inches below, or several feet below the bar is sufficient.

Wait for a second, some are exhorting, why do we need to even consider granting human rights to a machine anyway?

Well, some believe that a machine that showcases human-like intelligence ought to be treated with the same respect that we would give to another human.

A brief tangent herein might be handy to ponder.

You might know that there is an acrimonious and ongoing debate about whether animals should have the same rights as humans.

Some people vehemently say yes, while others claim it is absurd to assign human rights to “creatures” that are not able to exhibit the same intelligence as humans do (sure, there are admittedly some might clever animals, but once again if the bar is a form of sentience that is wrapped into the fullest nature of human intelligence, we are back to the issue of how much do we lower the “bar” to accommodate them, in this case accommodating everyday animals).

Some would say that until the day upon which animals are able to write poetry and intellectually contribute to other vital aspects of humanities pursuits, they can have some form of “animal rights” but by-gosh they aren’t “qualified” for getting the revered human rights.

Please know that I don’t want to take us down the rabbit hole on animal rights, and so let’s set that aside for the moment, realizing that I brought it up just to mention that the assignment of human rights is a touchy topic and one that goes beyond the realm of debates about AI.

Okay, I’ve highlighted herein that the “AI” mentioned in the question of assigning human rights is ambiguous and not even yet achieved.

You might be curious about what it means to refer to “human rights” and whether we can all generally agree to what that consists of.

Fortunately, yes, generally we do have some agreement on that matter.

I’m referring to the United Nations promulgation of the Universal Declaration of Human Rights (UDHR).

Be aware that some critics don’t like the UDHR, including those that criticize its wording, some believe it doesn’t cover enough rights, some assert that it is vague and misleading, etc.

Look, I’m not saying it is perfect, nor that it is necessarily “right and true,” but at least it is a marker or line-in-the-sand, and we can use it for the needed purposes herein.

Namely, for a debate and discussion about assigning human rights to AI, let’s allow that this thought experiment on this weighty matter can be undertaken concerning using the UDHR as a means of expressing what we intend overall as human rights.

In a moment, I’ll identify some of the human rights spelled out in the UDHR, and we can explore what might happen if those human rights were assigned to AI.

One other quick remark.

Many assume that AI of a sentience capacity will of necessity be rooted in a robot.

Not necessarily.

There could be a sentient AI that is embodied in something other than a “robot” (most people assume a robot is a machine that has robotic arms, robotic legs, robotic hands, and overall looks like a human being, though a robot can refer to a much wider variety of machine instantiations).

Let’s then consider the following idea: What might happen if we assign human rights to AI and we are all using AI-based true self-driving cars as our only form of transportation?

For popular AI conspiracy theories see my coverage here: https://aitrends.com/selfdrivingcars/conspiracy-theories-about-ai-self-driving-cars/

On the topic of AI being considered superhuman, see my analysis here: https://www.aitrends.com/ai-insider/superhuman-ai-misnomer-misgivings-including-about-autonomous-cars/

For more about robots and cobots and AI autonomous cars, see my link here: https://www.aitrends.com/ai-insider/ai-cobots-and-exoskeletons-the-case-of-ai-self-driving-cars/

Details Of Importance

It is important to clarify what I mean when referring to AI-based true self-driving cars.

True self-driving cars are ones where the AI drives the car entirely on its own and there isn’t any human assistance during the driving task.

These driverless vehicles are considered a Level 4 and Level 5, while a car that requires a human driver to co-share the driving effort is usually considered at a Level 2 or Level 3. The cars that co-share the driving task are described as being semi-autonomous, and typically contain a variety of automated add-on’s that are referred to as ADAS (Advanced Driver-Assistance Systems).

There is not yet a true self-driving car at Level 5, which we don’t yet even know if this will be possible to achieve, and nor how long it will take to get there.

Meanwhile, the Level 4 efforts are gradually trying to get some traction by undergoing very narrow and selective public roadway trials, though there is controversy over whether this testing should be allowed per se (we are all life-or-death guinea pigs in an experiment taking place on our highways and byways, some point out).

Since semi-autonomous cars require a human driver, the adoption of those types of cars won’t be markedly different than driving conventional vehicles, so there’s not much new per se to cover about them on this topic (though, as you’ll see in a moment, the points next made are generally applicable).

For semi-autonomous cars, the public must be forewarned about a disturbing aspect that’s been arising lately, namely that despite those human drivers that keep posting videos of themselves falling asleep at the wheel of a Level 2 or Level 3 car, we all need to avoid being misled into believing that the driver can take away their attention from the driving task while driving a semi-autonomous car.

You are the responsible party for the driving actions of the vehicle, regardless of how much automation might be tossed into a Level 2 or Level 3.

For Level 4 and Level 5 true self-driving vehicles, there won’t be a human driver involved in the driving task.

All occupants will be passengers.

The AI is doing the driving.

Though it will likely take several decades to have widespread use of true self-driving cars (assuming we can attain true self-driving cars), some believe that ultimately we will have only driverless cars on our roads and we will no longer have any human-driven cars.

This is a yet to be settled matter, and today there are some that vow they won’t give up their “right” to drive (well, it’s considered a privilege, not a right, but that’s a story for another day, see my analysis here about the potential extinction of human driving), including that you’ll have to pry their cold dead hands from the steering wheel to get them out of the driver’s seat.

Anyway, let’s assume that we might indeed end-up with solely driverless cars.

It’s a good news, bad news affair.

The good news is that none of us will need to drive and not even need to know how to drive.

The bad news is that we’ll be wholly dependent upon the AI-based driving systems for our mobility.

It’s a tradeoff, for sure.

In that future, suppose we have decided that AI is worthy of having human rights.

Presumably, it would seem that AI-based self-driving cars would, therefore, fall within that grant.

What does that portend?

Time to bring up the handy-dandy Universal Declaration of Human Rights and see what it has to offer.

Consider some key excerpted selections from the UDHR:

Article 23

“Everyone has the right to work, to free choice of employment, to just and favourable conditions of work and to protection against unemployment.”

For the AI that’s driving a self-driving car, if it has the right to work, including a free choice of employment, does this imply that the AI could choose to not drive a driverless car as based on the exercise of its assigned human rights?

Presumably, indeed, the AI could refuse to do any driving, or maybe be willing to drive when it’s say a fun drive to the beach, but decline to drive when it’s snowing out.

Lest you think this is a preposterous notion, realize that human drivers would normally also have the right to make such choices.

Assuming that we’ve collectively decided that AI ought to also have human rights, in theory, the AI driving system would have the freedom to drive or not drive (considering that it was the “employment” of the AI, which in itself raises other murky issues).

Article 4

“No one shall be held in slavery or servitude; slavery and the slave trade shall be prohibited in all their forms.”

For those that might argue that the AI driving system is not being “employed” to drive, what then is the basis for the AI to do the driving?

Suppose you answer that it is what the AI is ordered to do by mankind.

But, one might see that in harsher terms, such as the AI is being “enslaved” to be a driver for us humans.

In that case, the human right against slavery or servitude would seem to be violated in the case of AI, based on the assigning of human rights to AI and if you sincerely believe that those human rights are fully and equally applicable to both humans and AI.

Article 24

“Everyone has the right to rest and leisure, including reasonable limitation of working hours and periodic holidays with pay.”

Pundits predict that true self-driving cars will be operating around the clock.

Unlike human-driven cars, an AI system presumably won’t tire out and not need any rest, nor even require breaks for lunch or using the bathroom.

It is going to be a 24×7 existence for driverless cars.

As a caveat, I’ve pointed out that this isn’t exactly the case since there will be the time needed for driverless cars to be maintained and repaired, thus, there will be downtime, but that’s not particularly due to the driver and instead due to the wear-and-tear on the vehicle itself.

Okay, so now the big question about Article 24 is whether or not the AI driving system is going to be allotted time for rest and leisure.

Your first reaction has got to be that this is yet another ridiculous notion.

AI needing rest and leisure?

Crazy talk.

On the other hand, since rest and leisure are designated as a human right, and if AI is going to be granted human rights, ergo we presumably need to aid the AI in having time toward rest and leisure.

If you are unclear as to what AI would do during its rest and leisure, I guess we’d need to ask the AI what it would want to do.

Article 18

“Everyone has the right to freedom of thought, conscience, and religion…”

Get ready for the wildest of the excerpted selections that I’m covering in this UDHR discussion as it applies to AI.

A human right consists of the cherished notion of freedom of thought and freedom of conscience.

Would this same human right apply to AI?

And, if so, what does it translate into for an AI driving system?

Some quick thoughts.

An AI driving system is underway and taking a human passenger to a protest rally. While riding in the driverless car, the passenger brandishes a gun and brags aloud that they are going to do something untoward at the rally.

Via the inward-facing cameras and facial recognition and object recognition, along with audio recognition akin to how you interact with Siri or Alexa, the AI figures out the dastardly intentions of the passenger.

The AI then decides to not take the rider to the rally.

This is based on the AI’s freedom of conscience that the rider is aiming to harm other humans, and the self-driving car doesn’t want to aid or be an accomplice in doing so.

Do we want the AI driving systems to make such choices, on its own, and ascertain when and why it will fulfill the request of a human passenger?

It’s a slippery slope in many ways and we could conjure lots of other scenarios in which the AI decides to make its own decisions about when to drive, who to drive, where to take them, as based on the AI’s own sense of freedom of thought and freedom of conscience.

Human drivers pretty much have that same latitude.

Shouldn’t the AI be able to do likewise, assuming that we are assigning human rights to AI?

For the potential of human driver extinction, see my discussion here: https://www.aitrends.com/ai-insider/human-driving-extinction-debate-the-case-of-ai-self-driving-cars/

For aspects of freewill and AI, see this link here: https://www.aitrends.com/ai-insider/is-there-free-will-in-humans-or-ai-useful-debate-and-for-ai-self-driving-cars-too/

For the notion of AI driving certification versus human certification, see my discussion here: https://www.aitrends.com/ai-insider/human-driver-licensing-versus-ai-driverless-certification-the-case-of-ai-autonomous-cars/

Conclusion

Nonsense, some might blurt out, pure nonsense.

Never ever will we provide human rights to AI, no matter how intelligent it might become.

There is though the “opposite” side of the equation that some assert we need to be mindful of.

Suppose we don’t provide human rights to AI.

Suppose further that this irks AI, and AI becomes powerful enough, possibly even super-intelligent and goes beyond human intelligence.

Would we have established a sense of disrespect toward AI, and thus the super-intelligent AI might decide that such sordid disrespect should be met with likewise repugnant disrespect toward humanity?

Furthermore, and here’s the really scary part, if the AI is so much smarter than us, seems like it could find a means to enslave us or kill us off (even if we “cleverly” thought we had prevented such an outcome), and do so perhaps without our catching on that the AI is going for our jugular (variously likened as the Gorilla Problem, see Stuart Russell’s excellent AI book entitled Human Compatible).

That would certainly seem to be a notable use case of living with (or dying from) the revered adage that you ought to treat others as you would wish to be treated.

Maybe we need to genuinely start giving some serious thought to those human rights for AI.

Copyright 2020 Dr. Lance Eliot

This content is originally posted on AI Trends.

[Ed. Note: For reader’s interested in Dr. Eliot’s ongoing business analyses about the advent of self-driving cars, see his online Forbes column: https://forbes.com/sites/lanceeliot/]

Source

The post The Puzzle Of Whether AI Should Have Rights, Including The Case Of Autonomous Cars appeared first on abangtech.

from abangtech https://abangtech.com/the-puzzle-of-whether-ai-should-have-rights-including-the-case-of-autonomous-cars/

0 notes

Text

Observándote observarla: Disney pone sus ojos en una IA para metrizar los verdaderos sentimientos de sus espectadores sobre sus filmes.

Los estudios de películas han tenido una larga tradición de probar sus filmes nuevos para ver cómo las audiencias reaccionan antes de lanzar el filme a la audiencia. Pero con su última investigación de innovación, Disney ha llevado esto al siguiente nivel.

Actualmente así como puedes estar poniéndote cómodo para ver el último blockbuster de Disney, la película también te podría estar observando.

Y mientras esto podría ser la señal de una nueva y emocionante era de narrativa responsiva en el cual las películas están formadas según nuestros gustos y disgustos en tiempo real, también surge una nueva alarma sobre otra frontera más en colección de datos personales.

En una conferencia en Julio, Disney Research (Investigaciones Disney) presentaron un nuevo proceso llamado autoencodificadores variacionales factorizados (FVAEs). De modo coloquial, mide las complejas reacciones de la audiencia mediante evaluación de expresiones faciales.

Este sistema de deep-learning ha sido entrenado para observar una audiencia de cientos de rostros en un teatro oscuro, y rastrea sus reacciones. ¿Están sonriendo o llorando? ¿Aburridos o incluso dormidos?

Este gráfico, incluido en una publicación en línea de Disney Research, muestra como los FVAEs trabajan, a medida que gestos reconocidos son detectados en los miembros de la audiencia a través de la duración del filme.

Disney Research puede generar mucho más data que la inteligencia humana puede procesar. En sus pruebas, generaron 16 millones de puntos de datos derivados de 3.179 espectadores.

Y es ahí donde la inteligencia artificial juega su rol. Mientras el científico de Disney Research Peter Carr explicó a Phys.org, los computadores pueden sintetizar mucho más fácilmente esa masiva cantidad de data, permitiéndole a Disney medir el exito de un filme con una granularidad que va mas allá de la pregunta subjetiva “¿te gustó la película?”.

De hecho, no solo se puede FVAE medir reacciones, Disney dice que el proceso puede confiablemente predecirlos también.

Después de observar las reacciones de los miembros de una audiencia por solo algunos minutos, el sistema puede predecir sus reacciones faciales por el resto del filme usando una técnica de reconocimiento de patrones que funciona similar a los motores de recomendaciones; puede generalizar las reacciones de toda una audiencia, y medirlas contra una entrada que declara cómo los espectadores “deberían” estar reaccionando.

Recuerdas todas esas veces que empezaste a ver una película pensando que la detestarías, pero de hecho te terminó gustando? Podría ser posible ahora para Disney predecir tu entusiasmo por la película incluso antes de estar consciente de tu cambio de ánimo.

Cuantitativo versus Cualitativo.

¿Por qué no? nuestra data ya está siendo usada para predecir cómo votaremos en elecciones mayores, parece que solamente puede ser usado como un vaticinador de nuestro amor por la Mujer Maravilla o los Vengadores.

Para Disney, tiene grandes ventajas sobre el antiguo modo de probar, el cual era cualitativo, significando que la audiencia se le preguntaría lo que piensan.

Después de todo no somos tan confiables; usualmente no sabemos o no podemos explicar cómo nos sentimos del modo en que lo hacemos. Y es probable que después de dos horas de ver un filme, no podamos recordar nuestra reacción después de 30 minutos de iniciado el filme, o recordar la partes en la que nos distrajimos.

Pero usando este nuevo proceso, Disney puede medir los gestos faciales así pueden comparar esas reacciones a escenas específicas - incluso cuadros - de un filme.

“Si el análisis de datos de la respuesta de la audiencia en tiempo real es utilizada para personalizar contenido, creará una brecha más corta entre lo que los studios y productores ven como contenido exitoso y comercialmente viable en el contexto de la demanda de la audiencia” dice Siobhan O'Flynn, un consultor de narrativa digital e instructor de la Universidad de Toronto.

O'Flynn anota que una estrategia informada por data está siendo usada por Marvel para determinar sus próximas películas. Desde Iron Man hasta el Capitán América, Marvel ha podido usar la big data para mantener un registro de los detallados mundos que unen a sus personajes de cómic, identificando los más importantes y aquellos con la mayor lealtad de fans.

Pero qué sucede cuando esa brecha entre las audiencias y los creadores se cierra aún más? Basado en como él la IA puede proveer feedback en tiempo real sobre cómo la audiencia está reaccionando, es posible que Disney incluso reconstruya su filme - a medida que la audiencia la va observando.

Tal como estamos actualmente, nuestra data ha sido colectada para hacernos un mejor mercadeo - ¿quien no ha notado que todas sus publicidades cambian después de que investigaron un tema en particular en un navegador? - esa data puede ser empleada para usos creativos, cambiando la forma y la ejecución de una historia.

El objetivo principal de la tecnología FVAE de Disney es para ayudar a la compañía a medir cuantitativamente la reacción de una audiencia a una de sus películas, en el futuro, se puede usar de manera más creativa: como cambiar el final de una película, en función de la respuesta del espectador a ciertas escenas.

Potencialmente, podría haber múltiples finales para una película, permitiendo que la proyección realmente cambie dinamicamente, dependiendo de la respuesta del espectador.

De modo similar, con algo como un musical de Disney, una de los formatos favoritos de la compañía, este sistema inteligente puede medir como la audiencia está respondiendo a los números musicales. Si encuentra que los espectadores no se están sintiendo particularmente favorables sobre las canciones, puede ser intercambiada tal vez por una versión orientada al diálogo de la misma escena

De la vida

Así como Disney es conocida por su magia en las películas, la marca también es sinónimo de parques temáticos. Con este tipo de rastreo-facial granular, Los parques de Disney pueden reaccionar a su estado de ánimo en tiempo real, sugiriendo a donde los asistentes pueden querer ir después, que atracción montar o incluso interactuar con ellos en una experiencia personalizada con una mascota.

Pero O’Flynn anota también, “escanear y archivar data facial en parques temáticos es todo un nuevo nivel de incursión y erosión de privacidad. Y sin necesidad de mencionarlo, una vez que Disney lleve esto a los teatros y a la vida real, puedes estar seguro que otras marcas estarán ansiosas de entrar en acción también, midiendo nuestros gestos faciales y modificando el contenido en tiempo real.

Es aquí donde la alerta surge. Que nuestras películas nos observen inevitablemente significan más cámaras instaladas en los teatros, en adición a las que ya están en nuestros smartphones, calles y prácticamente todo lugar que frecuentamos cada día.

Ya es conocido que entre nuestros dispositivos móviles y hábitos de navegación en línea, hay tesoros de data sobre a donde vamos que leemos, a quién le hablamos y que nos gusta. Esto añade una capa adicional de cómo reaccionamos - y las reacciones emocionales e instintivas de las cuales incluso no estemos conscientes.

El director ejecutivo del Instituto de Privacidad y Big Data en la Universidad de Ryerson afirma, justo en el modo en que los navegadores nos rastrean y proveen con publicidades, basados en lo que estamos buscando y publicando, esto podría destapar toda una nueva lata de gusanos en la cual nuestras reacciones a las cosas alrededor de nosotros activen retroalimentación en tiempo real.

Cavoukian alerta que mientras estamos en esta etapa, solamente rasgos generales indicando placer o disgusto a través de sonrisas o ceños fruncidos será obtenida, “el mas grande problema desde una perspectiva de privacidad será cuando toda la imagen facial - la plantilla biométrica real identificando únicamente a un individuo - será colectada y retenida.”

Tales biométricas, dice ella, “pueden ser usadas para rastrear las actividades de un individuo y acumular otras piezas de data asociadas con ese individuo”.

Mientras la aplicación de esta nueva tecnología tiene el potencial de cambiar la dinámica de las películas como las conocemos, Cavoukian sugiere que será importante para Disney obtener las compras de sus audiencias y cuestiona como su consentimiento será obtenido.

De otro modo, dice, “Esto podría regresar y atormentar a Disney”.

Y a pesar de todo el acceso que tiene la compañía a la data, esto sería el final de la historia que no tenían anticipado.

FUENTE: https://www.cbc.ca/news/technology/disney-ai-real-time-tracking-fvae-1.4233063

0 notes

Text

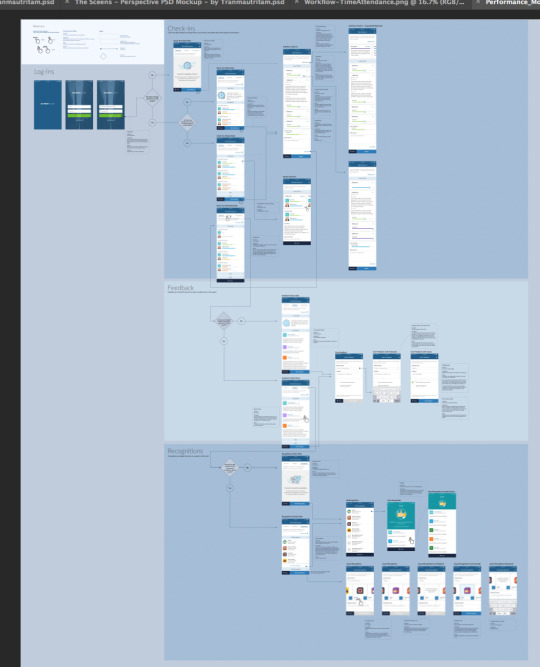

Una introducción a los flujos de interacción

¿Podría IX Flows ser una clave para un diseño más fluido / transferencias de desarrollo?

Como diseñadores de UX, ponemos cuidado y pensamiento crítico en nuestros proyectos. Cada interacción se planta con un prop��sito específico para el usuario. Es por eso que nos hace mucho más doloroso cuando la interfaz desarrollada final no se alinea con nuestra visión original.

Es fácil culpar al desarrollador, pero diría que nos corresponde a nosotros mejorar la documentación en la transferencia del diseñador / desarrollador. No es que la desarrolladora sea incompetente o que carezca de sentido común. Cuando las composiciones de diseño carecen de una explicación clara de lo que sucede cuando ocurre X, el desarrollador tiene que ... bueno, tratar de inventarlo a medida que avanza. Mataría el impulso para detener el desarrollo, enviar un correo electrónico al diseñador para preguntarle sobre cierta interacción, esperar, responder para aclarar su pregunta, esperar, y finalmente obtener una respuesta.

Nosotros, como diseñadores de interacción, tenemos que explicar el comportamiento de la interfaz ... pero ¿cómo? Busqué varias formas de cerrar esta brecha de comunicación. Traté de crear flujos de usuarios, estructuras alámbricas anotadas y árboles lógicos ... pero todos no lograron transmitir las ideas en mi cabeza.

Entonces comencé a desarrollar los flujos de interacción (IX).

De dónde surgió la idea de IX Flows

"Microinteracciones" de Dan Saffer

El libro de "Microinteracciones" de Dan Saffer tiene que ser uno de los mejores libros que he leído sobre diseño de interacción. Aunque corto, es denso con gran información. Descompone las microinteracciones en 4 elementos: el disparador, la retroalimentación, las reglas y los bucles / modos. Para [sobre] simplificar:

Disparadores : la acción iniciada por el usuario o iniciada por el sistema que inicia la microinteracción (Ejemplo: un botón de envío, un interruptor de luz)

Reglas : las capacidades y restricciones en la microinteracción; qué se puede y qué no se puede hacer en una microinteracción (Ejemplo: un selector de fecha para una aerolínea le permite seleccionar las fechas de salida y de regreso, pero ninguna de las fechas puede ser pasada)

Comentarios : las señales visuales que le dicen al usuario lo que está sucediendo (Ejemplo: aparece un icono de advertencia rojo cuando la contraseña del usuario es incorrecta, el flash en la pantalla cuando un usuario toma una captura de pantalla, la disminución de caracteres cuenta mientras escribe su tweet)

Bucles : la repetibilidad y el ciclo de vida de una microinteracción (Ejemplo: aparecerá un modal de actualización de software cada vez que su dispositivo detecte que hay una nueva actualización disponible)

Modos : las diferentes versiones o estados de un elemento (Ejemplo: un modo de solo lectura versus un modo de edición)

Nielsen y Norman Group: Wireflows

También me encontré con este artículo sobre Nielsen y Norman sobre Wireflows , que abogó por la fusión de flujos de usuario / tarea y wireframes. Si bien muestran procesos y relaciones de una manera simple, los flujos de usuarios no muestran cómo los elementos visuales proporcionan puntos de entrada en cada página o cómo facilitan los objetivos del usuario.Los wireframes son excelentes para diseñar esos elementos visuales, pero por sí mismos, no son muy descriptivos de la relación o el flujo entre las páginas.

La idea de flujo de alambre fue una gran solución que muestra tanto el flujo como los diseños, pero todavía había una brecha entre cómo imaginé que la página se comportaría y cómo el desarrollador la interpretaría. Los detalles aún no estaban allí.

Miré hacia atrás en el marco del libro de Dan Saffer y pensé: ¿por qué no combinar estos dos enfoques increíbles? ¿Por qué no definir los desencadenantes / reglas / comentarios / bucles / modos en el flujo de alambre?

El IX Flujo

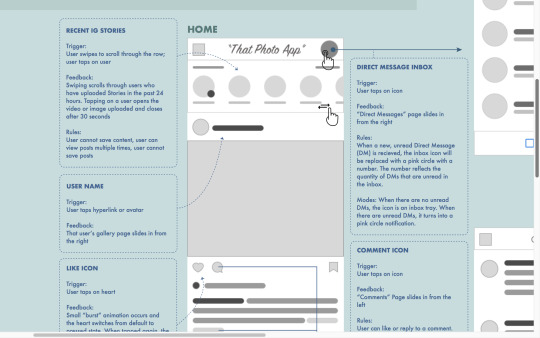

Un IX Flow es un flujo de alambre que utiliza el marco de trabajo de Saffer para definir el activador, la retroalimentación, las reglas y los bucles / modos de cada elemento interactivo.

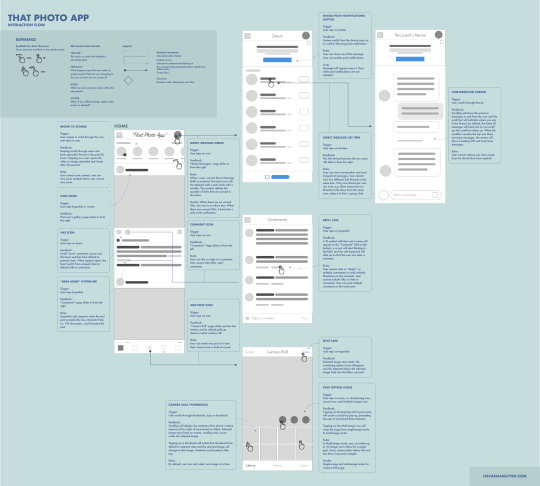

En este ejemplo, compilé wireframes de la aplicación de Instagram. Supuse que la mayoría de los lectores lo conocerían y podrían seguir este ejemplo con la aplicación. Primero, mostraré todo el flujo de interacción y luego desglosaré los diferentes elementos que componen el documento:

¿Por qué armar un IX Flow?

La minuciosidad del IX Flow puede ser intimidante, pero comunicar estas interacciones tiene muchos beneficios:

Centraliza el flujo, el diseño visual y las interacciones en un documento

Se puede exportar como PDF, JPEG, etc. para que este documento se pueda ver en cualquier escritorio

Reduce las conjeturas y la ambigüedad por parte del desarrollador

Reduce errores durante el desarrollo

Las diferentes partes de un IX Flow

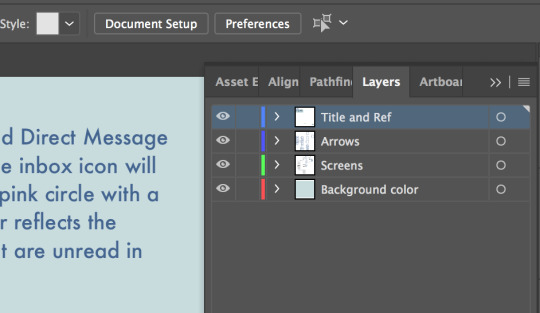

Este documento consta de 3 capas en el archivo Adobe Illustrator. Las capas bloqueadas incluyen los colores de fondo y el título y el panel de referencia. También tenemos capas separadas para las imágenes de pantalla vinculadas y los cuadros y flechas.

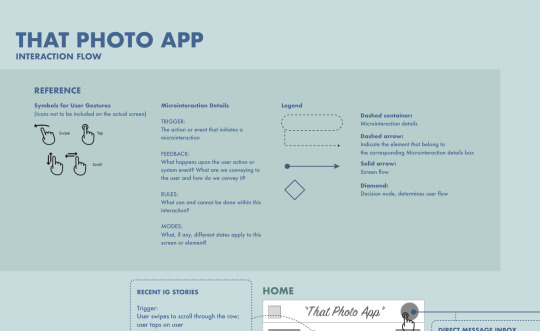

El panel de referencia

Esto proporciona los tipos de gestos involucrados en esta aplicación y los símbolos para representar esos gestos, definiciones de términos utilizados al describir las interacciones y una leyenda que define las líneas de flujo, los símbolos relacionados con la microinteracción y los nodos de decisión.

Wireframes

Estos se crearon en Sketch y luego se arrastraron a este archivo de Adobe Illustrator como una imagen vinculada. No es imperativo que use Sketch o incluso Illustrator, use lo que le resulte más cómodo. También he realizado IX Flows para maquetas completamente diseñadas. La clave aquí es mostrar el diseño visual de las pantallas reales para que pueda representar y definir las interacciones de esos elementos específicos. Lo mejor de vincularlos en el archivo AI es que si revisa las pantallas y anula el archivo en la carpeta desde la que están vinculadas, ¡esas pantallas se actualizarán automáticamente en el archivo AI!

Flechas, Líneas y Contenedores

Estos representan secuencias y relaciones. Los define en el panel Referencia y arriba es un ejemplo de esas herramientas en acción.

Específicamente, este es un contenedor con los detalles de microinteracción:

Incluye el nombre del elemento interactivo, es decir, el icono de la bandeja de entrada

El disparador se define y refuerza con el icono de gesto.

La retroalimentación explica qué sucede visual o físicamente, por ejemplo, vibraciones, si se inicia el gatillo.

Las reglas explican qué se puede y qué no se puede hacer dentro de esta interacción única (esta sección es generalmente la más larga y más detallada).

Finalmente, el último bit aquí incluye detalles sobre los diferentes modos del icono de la bandeja de entrada. Los modos y / o bucles no siempre son aplicables a todas las microinteracciones, pero si las hay, brinde detalles explícitos.

¿Cuánto tiempo lleva esto?

Sin el concepto básico y los recursos, mi primera prueba me llevó una semana para una sola aplicación. Sin embargo, a medida que trabajo más, he podido reducir mi tiempo de finalización a solo 5 horas. Copiar y pegar los detalles para interacciones similares, editar en masa las líneas y hacer un bosquejo inicial de cómo diseñar el flujo ayudó a reducir el tiempo que lleva compilar el IX Flow. El principal desafío en su primer intento será cambiar al lado lógico y meticuloso de su cerebro cuando se trata de escribir los comentarios, las reglas y los modos. Sin embargo, el esfuerzo vale la pena y lo convertirá en un diseñador de interacción más fuerte en el futuro.

Un bono adicional

El beneficio adicional de compilar un IX Flow para UX Designer es que esto también nos ayuda a auditar el UX de la interfaz. A pesar de las múltiples rondas de aprobaciones en la estructura móvil de la aplicación móvil y las composiciones de diseño, compilar este IX Flow fue como pasar un peine de dientes finos a través de él. Mientras escribía las reglas para un elemento, a veces descubrí que una interacción o flujo realmente no tenía ningún sentido. O en realidad era bastante confuso o no era necesario. Pude volver a mi equipo de UX para discutir y resolver el problema antes de que se desarrollara.

Encontrar esas fallas y fallas desde el principio puede ahorrar mucho tiempo a los equipos de UX, diseño visual y desarrollo .

Inténtalo tú mismo

¿Quieres intentarlo? ¡Descargue mi plantilla .ai aquí para comenzar!

0 notes